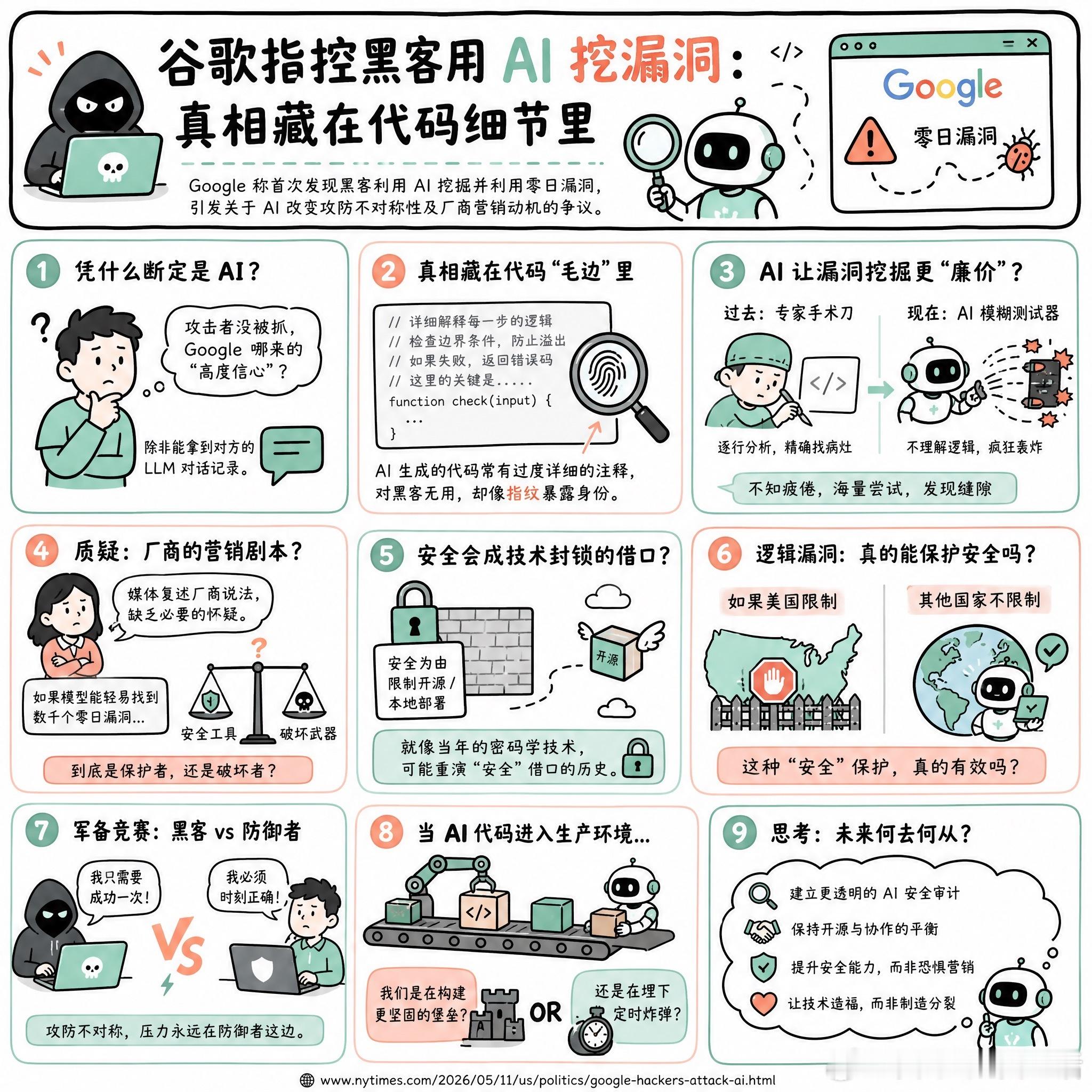

【谷歌指控黑客用 AI 挖漏洞:真相藏在代码细节里】

快速阅读:Google 声称首次发现黑客利用 AI 挖掘并利用了零日漏洞。这引发了关于 AI 是否正在改变网络攻防不对称性的激烈争论,以及技术厂商是否在利用这种恐惧进行市场营销的质疑。

有人在想,如果攻击者没被抓,Google 凭什么有“高度信心”断定这是 AI 干的?除非能拿到对方的 LLM 对话记录。

其实答案可能藏在代码的“毛边”里。有专家提到,AI 生成的代码往往带有某种特征,比如过度详细的解释性注释,这些东西对于追求效率的黑客来说毫无意义,却像是犯罪现场留下的指纹。

但这事儿细想有点不对劲。

现在的讨论里充斥着一种焦虑:AI 正在让漏洞发现变得廉价。如果说传统的漏洞挖掘是靠专家拿着手术刀在代码里一点点找病灶,那么 AI 就像是一个永不疲倦的模糊测试器(Fuzzing),它不需要理解系统逻辑,只需要对着某行晦涩的代码反复“轰炸”成千上万次。

不过,这种说法也有点像在为某些厂商的营销背书。有网友觉得,媒体在复述 Anthropic 等公司的说法时,缺乏必要的怀疑。毕竟,如果一个模型真的能轻易找到数千个零日漏洞,那它到底是安全工具,还是一个自带“破坏指令”的编译器?

更有意思的争议在于,安全是否会变成一种技术封锁的借口。就像当年的密码学技术一样,人们可能会以“安全”为由,试图限制开源模型和本地化部署。

但逻辑上存在一个漏洞:如果美国限制了高性能模型的开放,而其他国家没有,这种“安全”保护真的有效吗?

现在的局面很像是在进行一场军备竞赛。黑客只需要对一次,而防御者必须时刻保持正确。当 AI 写的代码开始大规模进入生产环境,我们究竟是在构建更坚固的堡垒,还是在往地基里埋下一堆随时会爆的定时炸弹?

www.nytimes.com/2026/05/11/us/politics/google-hackers-attack-ai.html